Exemple de vidéo IA, expliqué de A à Z

#12 - Aka ma participation à la Runway Big Ad Contest

Buenos dias !

Après ce weekend de Pâques quelque peu allongé (il y a un jour férié en France), il est temps de s’y remettre. Et pour clôturer le sujet de la semaine dernière, sur ce que l’on peut faire en vidéo avec l’IA, je te propose de te montrer un exemple très concret.

Dans cette édition, je vais donc reprendre la vidéo d’une minute que j’ai faite pour la Runway Big Ad Contest 2026, et t’expliquer en détail comment j’ai fait.

Allez, c’est parti.

Si ce n’est pas déjà le cas, tu peux aussi :

Me suivre sur LinkedIn, où je publie des posts complémentaires,

Découvrir les services que je propose, notamment dans le secteur de la finance…

… mais pas encore découvrir Licorn, ma nouvelle boîte.

Au programme

La vidéo en question

Les consignes de départ

L’écriture du scénario et des prompts

Comment générer une scène

Comment organiser une vidéo complète

Bande audio IA et montage

La fameuse vidéo

Je l’ai terminée dans la nuit de lundi à mardi dernier, à 2h40 du matin. Il fallait la poster le lendemain, ce que j’ai fait sur LinkedIn, via ce post en anglais, dans lequel j’ai essayé de retranscrire l’âme de ce que j’ai voulu créer.

La Runway Big Ad Contest

J’ai généré cette vidéo dans le cadre de ma participation à une compétition organisée par l’entreprise de génération de vidéo IA Runway. Il s’agit d’une entreprise qui travaille sur des modèles vidéo IA et qui propose également un logiciel SaaS pour générer des images et vidéos.

Pour te donner une petite idée de la taille de cette société, que l’immense majorité des gens ne connaît pas : ils ont déjà levé 860M$ et se sont valorisés à 5.3B$ lors de leur dernier tour.

Sur la partie logiciel, on peut utiliser leurs modèles, mais également les autres standards du marché. Sur ce point, c’est d’ailleurs le cas d’un peu tous. Il y a donc une compétition entre acteurs du marché, autant sur les meilleurs modèles de génération vidéo que sur la meilleure interface pour travailler.

À la suite de la sortie de Flick et de sa vidéo Flop! qui a fait le buzz, Runway a dégainé une semaine après une compétition avec 100 000 $ de prix pour les gagnants : la Runway Big Ad Contest. Le principe : créer une vidéo de 30 à 60 secondes, pour faire la promotion d’un produit qui n’existe pas.

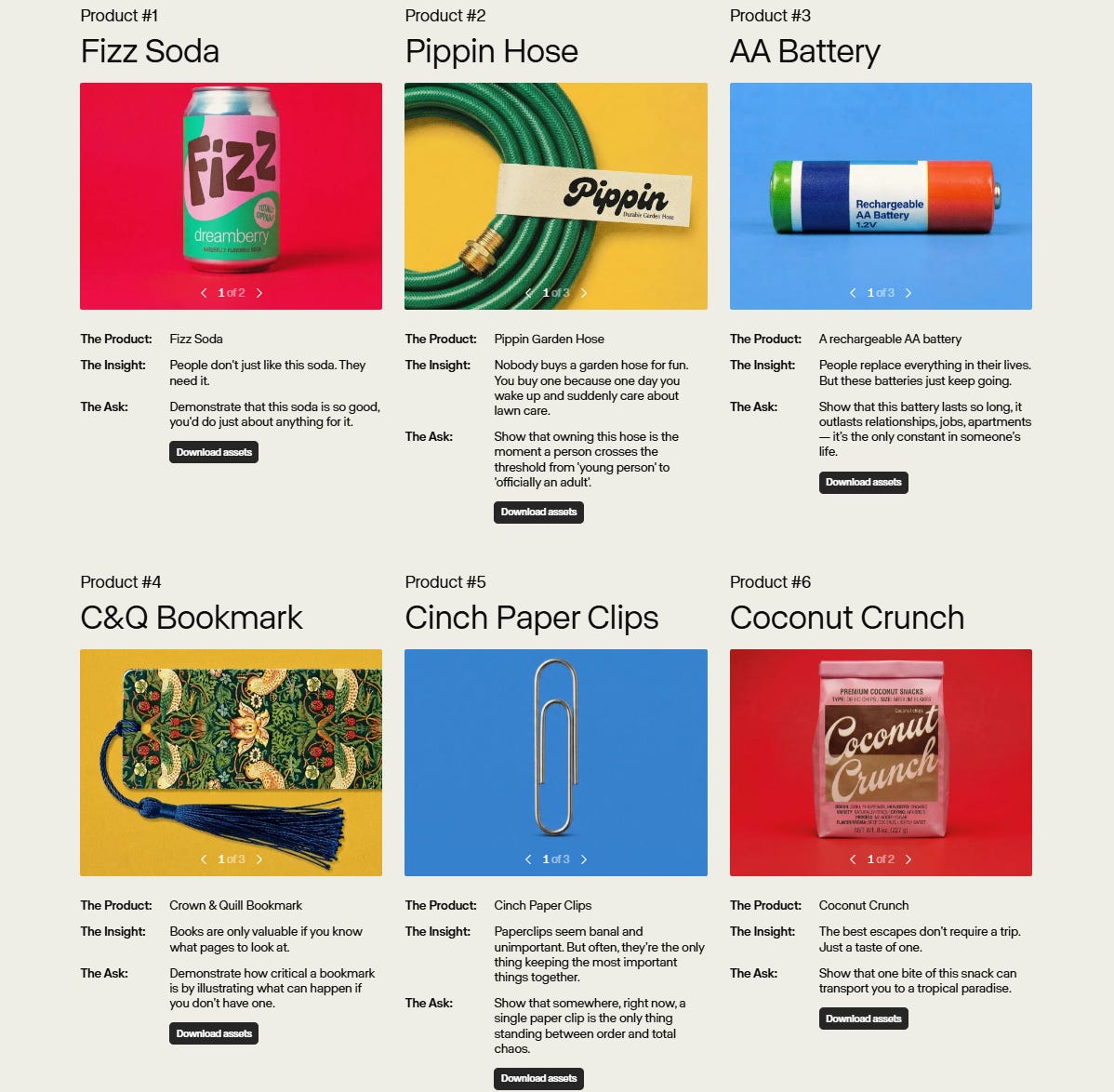

Voici la liste des produits qui était proposée 👇

Et j’ai donc choisi le trombone.

Et, franchement, si c’était à refaire… je prendrais un autre produit. Car la génération IA du trombone est tout bonnement un enfer : c’est trop fin, trop précis, pour ce que l’IA est capable de faire aujourd’hui. J’ai donc galéré et dû bricoler un peu. Je t’explique ça dans la suite de cette édition.

L’écriture du scénario et des prompts

Lorsque j’ai vu le trombone, j’ai immédiatement pensé à une histoire d’amour dont la suite ne tiendrait qu’à un fil — le trombone — et qui se déroulerait à New York il y a quelques décennies.

J’ai donc passé mon idée dans Claude avec Opus 4.6, ainsi que les références de la compétition Runway et les assets associés.

J’ai ensuite itéré avec le LLM sur un scénario réalisable — la principale contrainte étant que la vidéo tienne sur 60 secondes max — et nous avons produit un storyboard avec les prompts d’une vingtaine de scènes, que tu peux retrouver dans ce Google Doc.

Je précise que ce document a été produit 100% par Claude : je n’ai réalisé aucune retouche de style ou autre. J’ai juste itéré avec lui sur le scénario, et il a à la fin produit ce document hyper propre.

Comment générer une scène

Comme tu peux le voir dans le storyboard, on reprend le principe que j’évoquais dans la dernière édition de Founder Naked :

On génère d’abord une ou plusieurs images de référence,

Puis on s’appuie sur ces images pour générer une vidéo.

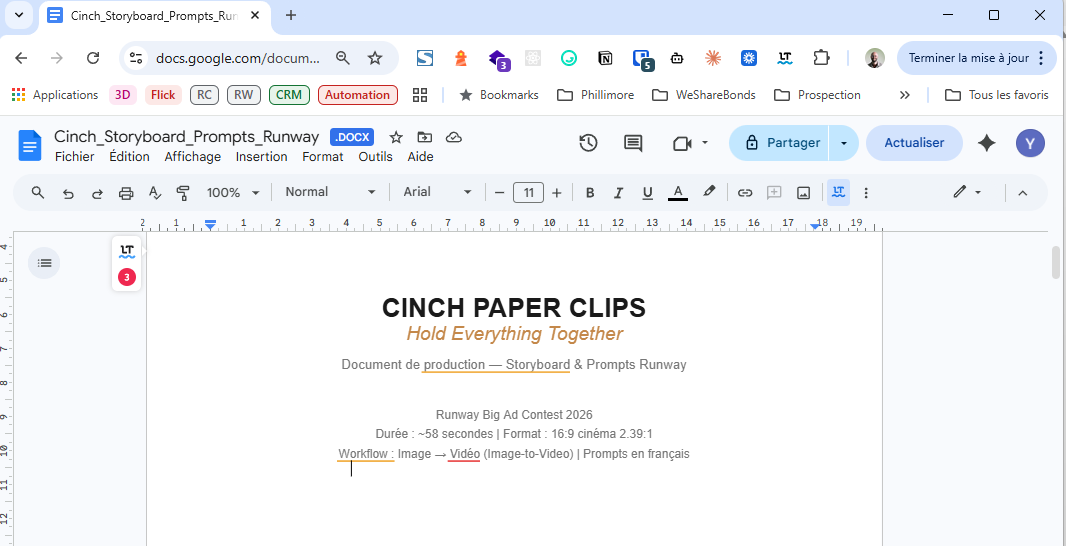

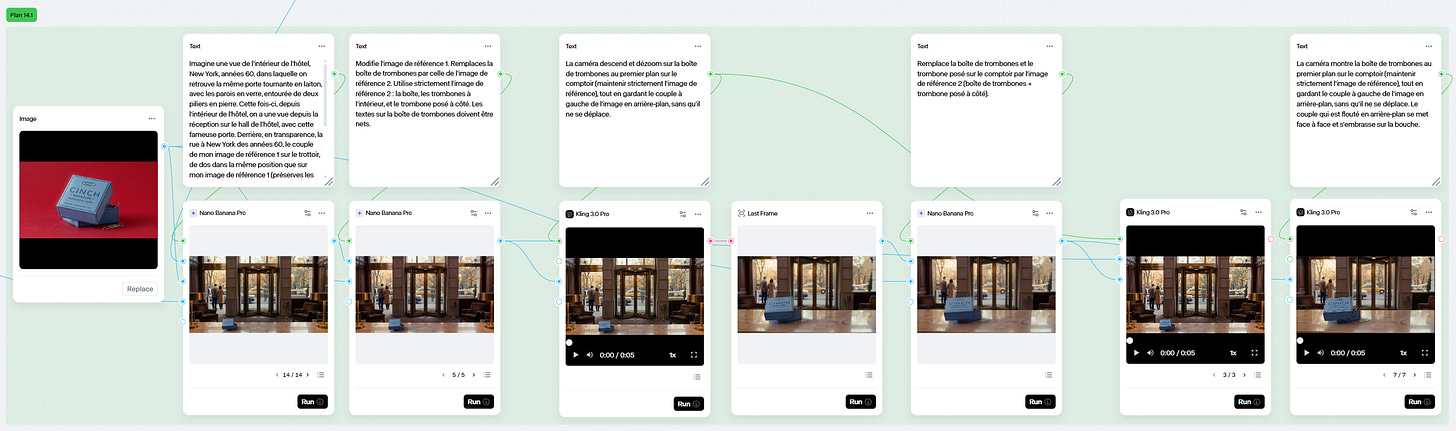

Pour une scène simple à générer, le workflow est très lisible 👇

J’ai un nœud de texte pour générer l’image de référence, que je passe à Nano Banana Pro, avec ici deux images de référence :

une photo du visage de mon personnage jeune,

et une image de l’objet qu’il tient dans les mains.

Une fois que je suis satisfait de l’itération (ici ça me convenait du premier coup, mais parfois je régénère plusieurs fois pour obtenir un résultat qui me convient), je passe ensuite cette image à un nœud vidéo, avec un prompt-to-video. Ici j’ai utilisé le modèle Kling 3.0 Pro.

Mais parfois, ce n’est pas si simple.

Sans partir dans une complexité extrême, où parfois on s’arrache littéralement les cheveux, voici un deuxième exemple déjà un peu plus complexe 👇

Il s’agit de la scène de fin, qui met en scène mon couple, l'hôtel devant lequel ils se trouvent, et la boîte de trombones référencée dans les consignes de la compétition.

Ici j’ai dû générer plusieurs fois les images, notamment car :

L’architecture de l’entrée de l'hôtel ne correspondait pas à celle que j’avais depuis la vue sur le trottoir. L’IA m’enlevait les piliers de chaque côté de la porte, par exemple.

Mon couple n’était pas dans la position souhaitée.

Ou plus symptomatique de mon choix de produit : les trombones générés au premier plan, ne ressemblaient pas à des trombones.

En effet souvent, même lorsque l’on passe une image de référence, l’IA a tendance à réinterpréter l’objet, et à en produire une version dégradée. J’ai donc plusieurs fois été obligé, une fois arrivé à une mise en scène satisfaisante, de remplacer explicitement un objet par un autre en image de référence.

En gros je fais générer la scène avec les différentes références. Mais pour que des choses précises, comme une boîte de trombones, correspondent, je suis ensuite obligé de lui demander au modèle de se concentrer uniquement sur cette tâche.

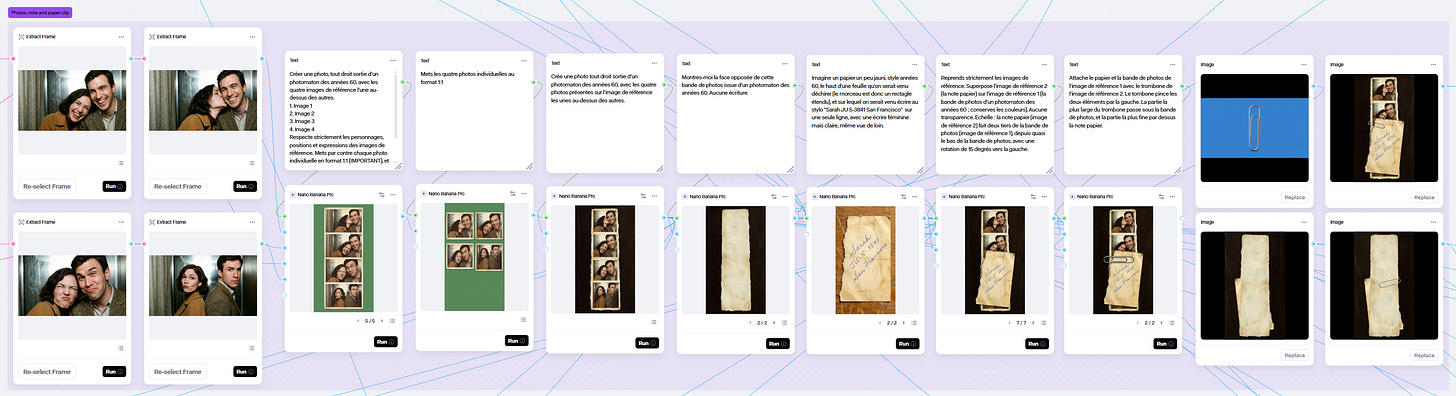

Cela m’a fait ça pour les trombones, et pour la bande de photos du photomaton.

Comment organiser une vidéo complète

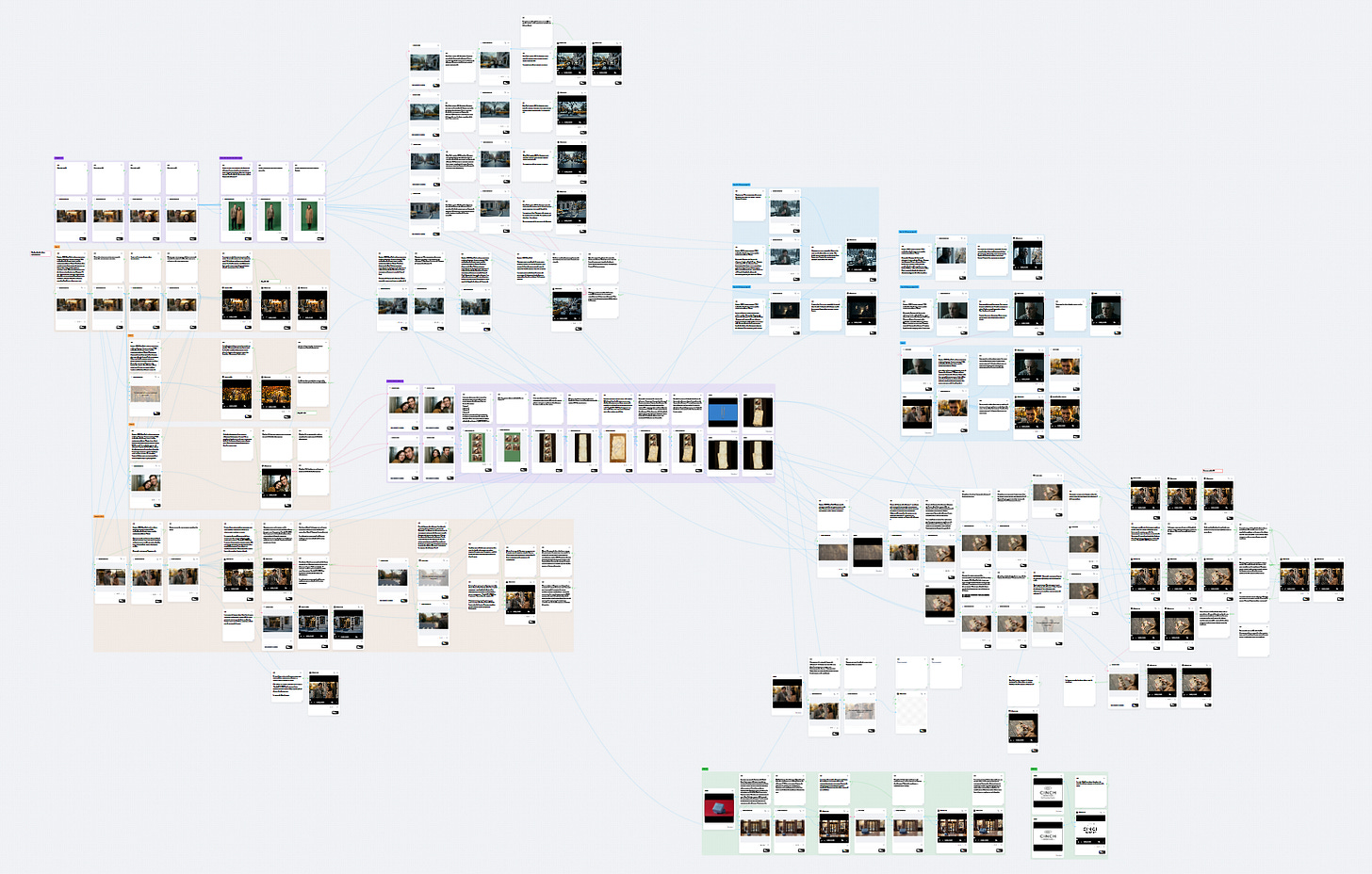

Je te mets ci-dessous mon workflow complet dans Runway 👇

Bon, oui, c’est illisible.

Mais cela te donne une idée de l’organisation.

Et si tu veux, en créant un compte gratuit, tu peux l’ouvrir via ce lien. Malheureusement, les images générées ne sont par contre pas conservées dans ce lien public.

Mais je te détaille ci-dessous les parties importantes.

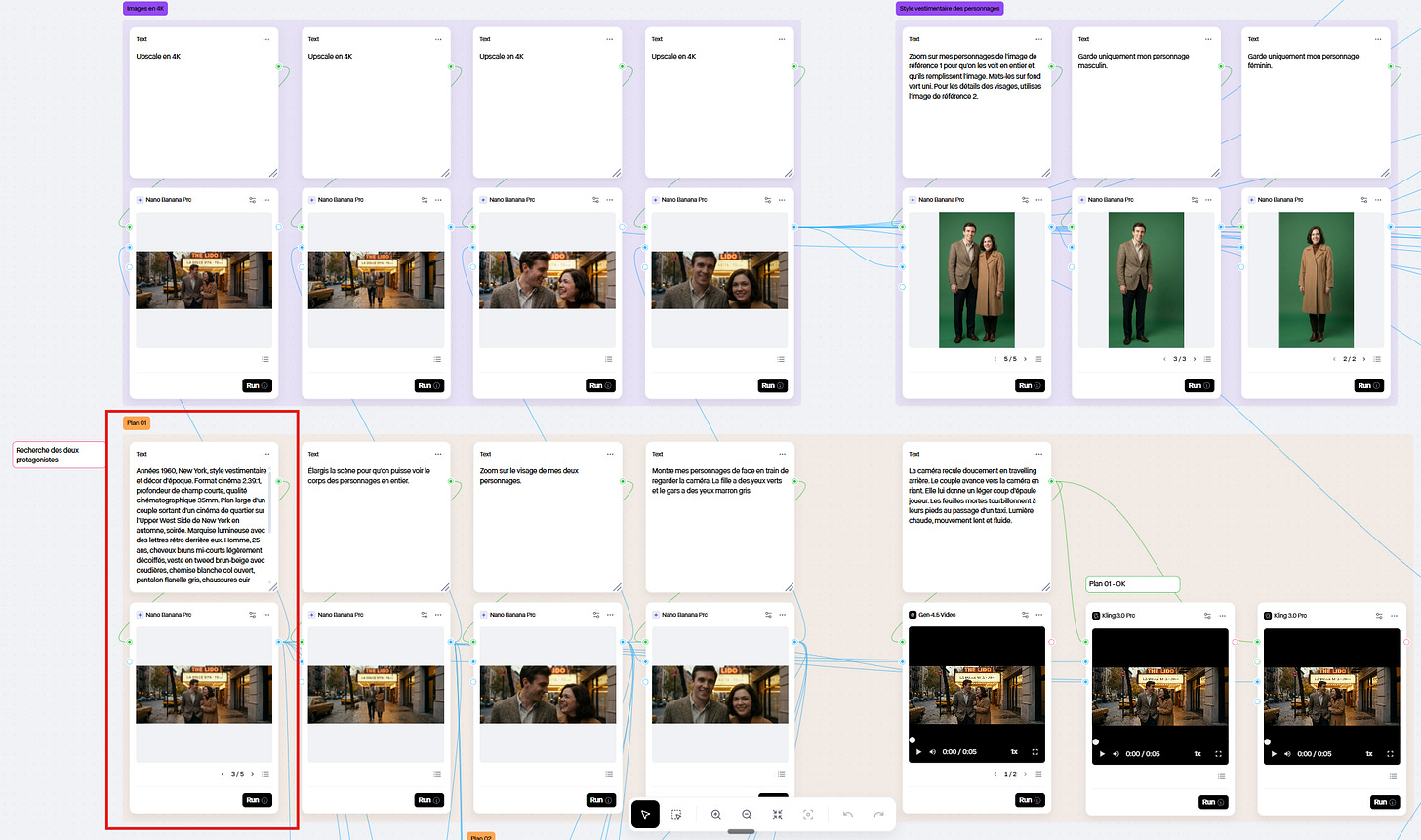

A. Le point de départ

Tout part de l’image que j’ai entourée en rouge ci-dessous. C’est cette image que j’ai générée en premier, sur laquelle j’ai itéré quelques fois avec le bon prompt, pour obtenir les personnages qui me plaisaient. Ensuite, à partir d’elle, j’ai généré :

Plusieurs niveaux de zoom de la même scène, notamment pour obtenir leurs tenues complètes, et les détails de leurs visages,

Leurs versions 4K, pour lorsque j’ai besoin de beaucoup de détails,

Les personnages seuls, lorsque je veux éviter tout autre contexte,

Et enfin la vidéo de la scène 1, dans laquelle ils sortent du cinéma.

B. Le point central

L’élément central de mon workflow, outre mes deux personnages que je réutilise via les images de référence générée au point A, c’est la bande de photos du photomaton.

Dans une scène du début, ils se prennent en photo dans un photomaton. Pour construire cette bande de photos, j’ai donc extrait des frames de la vidéo du photomaton, que j’ai ensuite assemblées pour obtenir cette fameuse bande de photos.

J’ai ensuite créé une note manuscrite avec un numéro crédible pour l’époque, en utilisant encore Claude :

Sarah JU 5-3841 San Francisco

Puis j’ai assemblé la note et la bande de photo dans Affinity. Et j’ai également fait le montage pour ajouter le trombone.

Création d’une bande audio IA et montage

Les consignes de la compétition précisaient qu’il fallait disposer des droits pour la bande audio… Et ça, ce n’est pas si simple !

Si on fait une vidéo TikTok par exemple, on peut utiliser leur panel de musiques. Or sans ça, la plupart des musiques que tu peux trouver ne sont pas libres de droits, ou tu ne les as pas sans payer de grosses sommes.

J’ai donc cherché du côté de la génération de bandes audio IA. J’ai testé Beatoven, qui permet de générer une bande audio à partir d’une vidéo (pour obtenir les frames) et d’un prompt. Franchement, le son généré n’était pas dingue du tout, sans compter que cela respectait le prompt très approximativement.

J’ai finalement testé puis opté pour AIVA, un autre outil qui permet de générer des musiques à partir d’un style que l’on choisit. J’ai ainsi généré 3 bandes audio différentes, pour les 3 séquences fortes de ma vidéo :

Puis j’ai assemblé les scènes et l’audio sur Capcut 👇

Le mot de la fin

Franchement, c’est très simple de s’y mettre. Et à défaut de gagner quelque-chose (a priori), la réalisation de cette fausse pub m’aura permis de tester les limites des modèles actuels, et ainsi de savoir, à date, ce que l’on peut et ne peut pas faire.

Des choses très concrètes, que j’applique dans la réalisation de mes vidéos Licorn à destination des réseaux sociaux : des vidéos de ma mascotte qui cuisine différentes recettes, et que tu découvriras bientôt sur les réseaux sociaux.

En attendant, bonne semaine !

Yoann