Comment créer une mascotte en 3D ?

#8 - Alors que j'ai finalement opté pour la 2D

Buenos dias !

Bienvenue dans cette 8e édition de Founder Naked.

Cette semaine, j’ai choisi de te montrer comment créer une mascotte en 3D à l’aide de l’IA, les avantages et les inconvénients, et pourquoi j’ai finalement opté pour la 2D.

C’est parti !

Si ce n’est pas déjà le cas, tu peux aussi :

Me suivre sur Linkedin, où je publie des posts complémentaires,

Découvrir les services que je propose, notamment dans le secteur de la finance…

… mais pas encore découvrir Licorn, ma nouvelle boîte.

Au programme

Déjà, pourquoi créer une mascotte ?

Comment apprendre à le faire ?

La mienne, étape par étape

Pourquoi j’ai finalement opté pour la 2D

Pourquoi créer une mascotte ?

Je pense que c’est pas mal de commencer par cette question, car c’est vrai : pourquoi s’embêter à faire ça, c’est du travail après tout…

D’ailleurs si je dois être totalement transparent : j’ai commencé à bosser sur la mienne au moment où mon design était “quelconque”. Autrement dit, je cherchais un moyen de devenir mémorable alors que le reste de mon identité graphique ne l’était pas tant que ça. Avec le recul, je me dis que lorsque j’ai commencé à bosser sur cette histoire de mascotte(s), c’était donc une forme de rustine.

Et c’est un peu ça le but d’une mascotte : créer un ancrage visuel qui fasse immédiatement penser à ta marque, et qui souvent, soit plus mémorable au final que ton logo ou ton identité visuelle seuls.

Cela peut permettre aussi de faire passer d’autres messages, ou de parler sur un autre ton, plus décalé par exemple. Tu peux très bien dissocier le discours de ta marque et le discours de ta mascotte, sans tomber non plus dans l’incohérence bien sûr. Il faut garder cette cohérence, mais tu peux par exemple te permettre d’être un peu plus léger avec une mascotte, tout en restant plus corporate avec ta marque.

Une mascotte permet également d’illustrer des fonctionnalités, de rendre plus interactives des parties de ton produit. Pour ma part, je développe des fonctionnalités d’assistant IA ; je cherchais donc aussi un moyen de rapprocher l’utilisateur de cette fonctionnalité, et de créer plus d’interaction. Une mascotte peut donc être statique, mais on peut aussi l’animer pour lui faire dire ou faire des choses.

On peut l’utiliser en vidéo également, pour lui faire montrer des choses, ou tout simplement pour faire du marketing : pour l’utiliser dans des spots pub, à la télé ou sur Google Display, des vidéos sur les réseaux sociaux…

Et enfin, et peut-être le point le plus important : l’IA a rendu accessible des processus de création qui étaient jusqu’alors fermés aux plus petites entreprises faute de budget. Désormais, n’importe qui, pour peu qu’il ait quelques idées à tester, peut créer quasiment ce qu’il veut.

Comment apprendre à créer une mascotte 3D ?

Je ne vais pas détailler le processus “traditionnel” de création d’une mascotte 3D. Exit la suite Adobe, les dizaines d’heures de travail et l’énorme expertise nécessaire pour créer un personnage en 3D.

Si j’avais dû passer par tout cela, je ne l’aurais probablement jamais fait. J’adore pourtant apprendre des choses en tout genre, et intellectuellement c’est passionnant ; mais en termes de bande passante, cela n’aurait pas été possible. C’est le genre de projet que normalement on fait pour un rebranding, quand on en a (enfin) les moyens, lorsqu’une agence nous dit que ça pourrait être un bon truc pour nous.

Mais désormais, « l’IA peut le faire ».

J’ai commencé par faire comme toi : j’ai été curieux. J’ai cherché sur Google, j’ai croisé avec ChatGPT, et surtout en “intro” et comme une forme d’accélérateur sur comment faire, j’ai trouvé une vidéo YouTube bien foutu, assez synthétique, qui sans me donner non plus tous les outils que j’ai finalement utilisés, aura au moins eu le mérite de poser les bases dans ma tête 👇

Je pense d’ailleurs qu’à la vue de la miniature de cette vidéo YouTube, il faut préciser ce que l’on entend par 3D. Je pense que l’on peut prendre le terme 3D sous deux angles :

Le personnage est dans un style 3D, comme ce pigeon ; non pas comme les dessins animés 2D par exemple. Mais cela reste une image et donc de la 2D ;

En opposition aux “vrais” personnages 3D qui possèdent quand à eux un squelette 3D et que l’on peut animer.

Mais dans tous les cas, que ce soit de manière traditionnelle ou à l’ère de l’IA, il faut commencer par de la 2D, c’est-à-dire une image à plat du personnage. Il faut trouver ses formes, son style, et seulement après s’occuper, si on le souhaite, de le passer en 3D. Et donc, à ce moment-là, d’en faire un personnage que l’on peut faire tourner sur soi-même, pour donner une image concrète du rendu final obtenu via la 3D.

Tutoriel pour créer sa mascotte 3D, étape par étape

Je préfère te le dire tout de suite : ce n’est PAS la mascotte Licorn définitive. Déjà parce qu’elle est en 2D et non en 3D (j’en expliquerai les raisons à la fin de cette édition), et parce qu’il s’agit ici de partager le processus de création de ma première ébauche, de mon premier test. Le processus est bon — et il est d’autant meilleur que les mois passent et que les modèles IA s’améliorent — mais pas la mascotte.

1/ Trouver l’inspiration

La première étape consiste à utiliser des logiciels qui vont aller dans tous les sens, et qui vont te permettre, quand tu ne sais pas très précisément ce que tu veux, de tester tes idées. Le but ici : savoir ce que l’on aime et ce que l’on n’aime pas. Visualiser ce que pourrait rendre un personnage comme on se le décrit (et on le décrit à l’IA), ou comme on se l’imagine.

Et c’est là où les logiciels / les modèles IA qui font des trucs “wahou” sont utiles. Je veux parler de ces modèles qui, quand ils sortent une nouvelle version, font faire de la planche à voile à un hamster. C’est trop bien fait, ça fait le buzz, et tout le monde se dit : “Wahou, c’est fou ce qu’on peut faire avec ce modèle !”.

La vérité c’est qu’en général ce genre de modèle :

Nécessite beaucoup d’itérations, genre beaucoup beaucoup, pour arriver à ce qui nous est montré sur les pubs de lancement ;

Et en général, les modèle bons pour trouver l’inspiration, sont nuls pour affiner un personnage, et encore moins pour maintenir sa cohérence pour son utilisation ultérieure.

Pour ma part j’en ai testés par mal :

Leonardo (depuis racheté par Canva)

Gemini / Nano Banana

Runway (qui depuis a clairement viré vers la vidéo)

…

Je ne vais pas mettre toutes les images ici — et pour certains outils, mon historique a été effacé, faute de plan payant — mais en gros les premiers, notamment Midjourney et Leonardo, m’ont permis de défricher mes idées et de savoir un peu mieux ce que je voulais / ce que j’aimais ou n’aimais pas.

Ensuite je suis passé sur ChatGPT, d’une part pour le suivi de mon contexte, comme je bosse avec pour le reste, et d’autre part car au-delà de générer plein de variantes pour trouver l’inspiration, c’est celui qui ensuite a su me générer des idées en collant le mieux à mon prompt. Pour cette étape en tout cas.

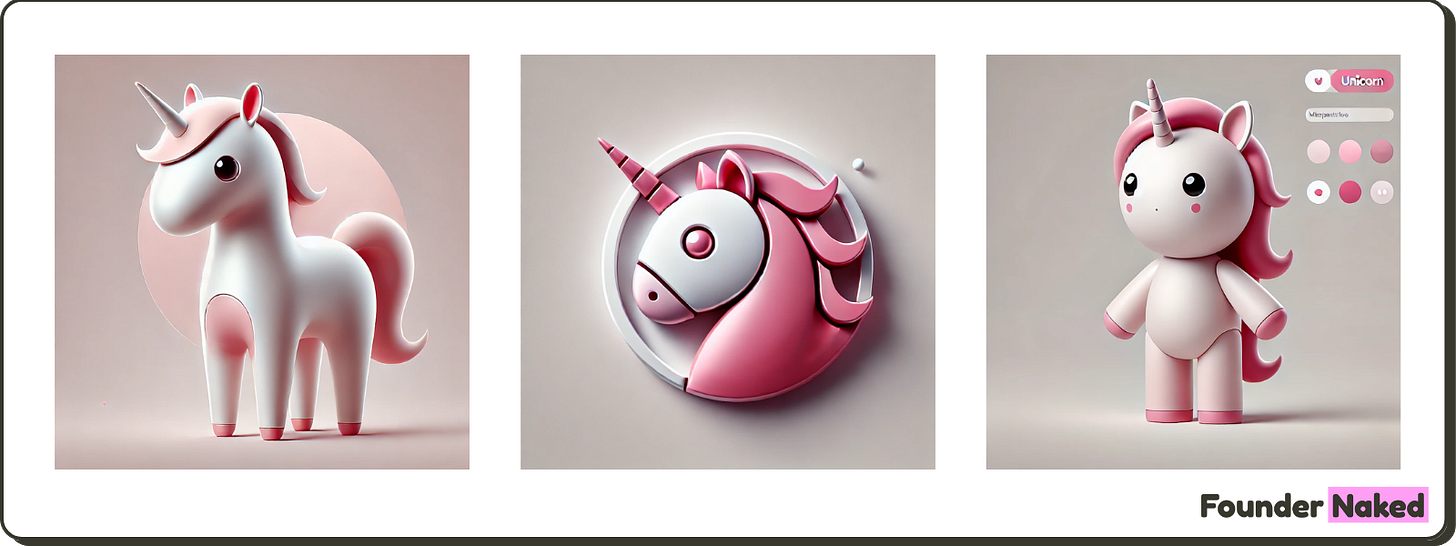

Alors attention, je ne dis pas que tout était parfait 😅👇

Déjà, c’était il y a 5 mois, donc les choses se sont améliorées depuis.

Mais en itérant un peu sur mon prompt, j’ai fini par obtenir une version que je trouvais satisfaisante :

Et c’est là où il ne faut pas être trop gourmand avec DALL·E / ChatGPT : quand tu obtiens ce que tu veux, par une forme de magie et de hasard (en plus d’un bon prompt), il faut savoir dire STOP. Et se partir ailleurs pour la suite du travail.

2/ Affiner le personnage

Car affiner un personnage, ce n’est pas donné à tous les modèles.

En effet, c’est relativement “facile” de tester ses idées et de générer des personnages. Mais dès qu’il s’agit :

D’aller rajouter une bouche parce qu’il en manque une,

D’aller retoucher un petit défaut aux oreilles,

De changer de posture…

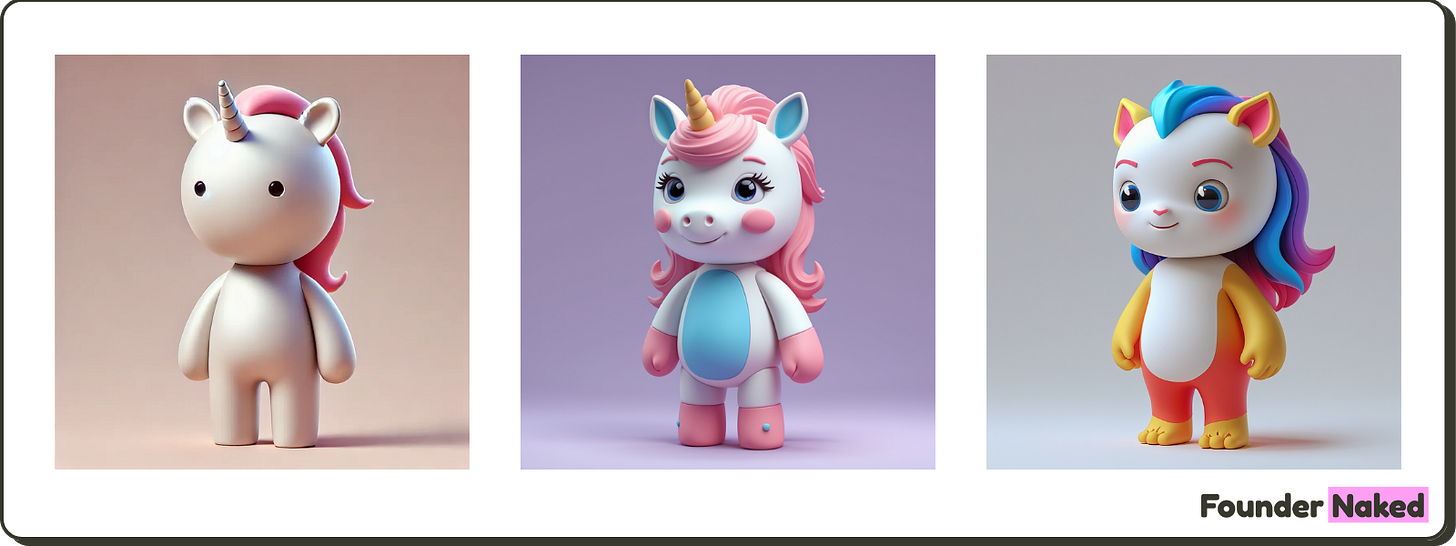

Là tous les modèles de se valent pas, ni tous les outils. Ci-dessous, je te montre un exemple de résultat que me sortait Lenonardo avec son modèle phare “Phoenix” (à l’époque la version 1.0). Je lui ai demandé de reproduire strictement mon personnage de gauche, en lui rajoutant une bouche et un nez 👇

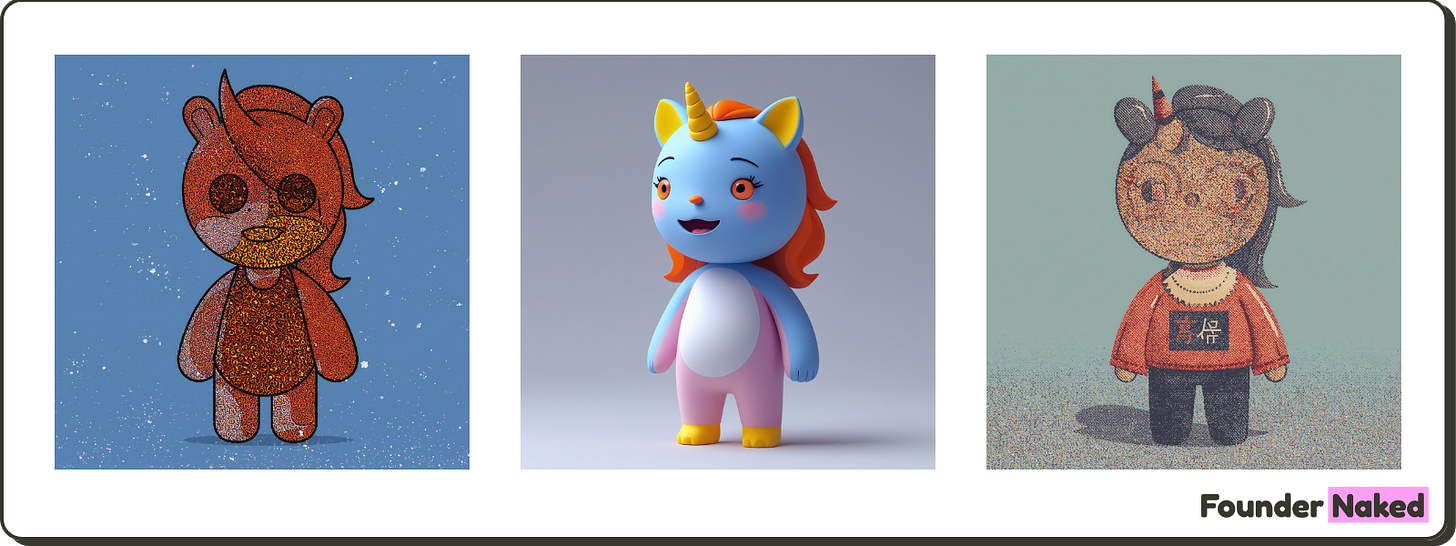

Cela permet aussi de se rendre compte — et ça j’ai mis du temps à le comprendre, le temps de faire ces premiers essais — que la plupart des modèles de génération d’images, disposent de leur “patte” artistique. Et que cette patte est très sympas quand on est dans la phase 1, que l’on veut faire des tests ; mais dès que l’on entre dans la phase 2 et que l’on veut affiner le même personnage, il faut trouver un modèle généraliste qui fait le job.

Par exemple, reproduction du même personnage, mais juste en changeant le modèle IA sur Leonardo (modèles ayant chacun leur “patte”) 👇

Tu vois que cela force le changement vers le style du modèle, quelle que soit l’instruction du prompt.

J’ai également tenté de continuer sur ChatGPT, mais j’obtenais des résultats assez aléatoires :

Si je tentais de trop éditer une version satisfaisante, il me la dénaturait rapidement ;

Mais en repartant régulièrement d’une version propre, j’ai réussi à itérer quelques fois.

Mais au final, c’est en utilisant Gemini et le modèle Nano Banana, que j’ai obtenu le meilleur taux de réussite sur cette partie modification.

D’ailleurs si tu veux tout savoir, aujourd’hui, avec beaucoup plus de recul, j’utilise toujours Nano Banana mais intégré dans le logiciel Recraft. Je n’utilise pas ou très peu les modèles Recraft, pour les raisons évoquées ci-dessus (chaque modèle a sa “patte”), mais je trouve l’interface géniale pour bosser au quotidien, et éditer mes personnages.

3/ Le passer en 3D (si ça te tente)

A partir d’une image satisfaisante d’un personnage — et j’insiste sur ce fait : ne penses pas pouvoir éditer a posteriori un personnage 3D, fais-le avant — on peut en générer une version 3D, que l’on peut ensuite animer, faire tourner sur soi-même, etc.

Un autre intérêt du personnage 3D est sa palette d’utilisation. Tu peux par exemple en faire des peluches. Le fait qu’il soit en 3D permet à un fabricant de reproduire fidèlement ta mascotte sous tous les angles, et d’en faire des goodies.

J’ai donc aussi testé ça, et benchmarké par l’usage (en testant moi-même) la plupart des outils du marché “du moment”. Je ne vais pas refaire une liste à la Prévert, mais en gros j’ai trouvé deux outils que je trouvais bien et que j’ai testé vraiment :

Meshy, très orienté personnages et objets de jeux vidéos,

et Tripo, avec aussi un ADN jeux vidéos, mais des cas d’usage un peu plus généralistes.

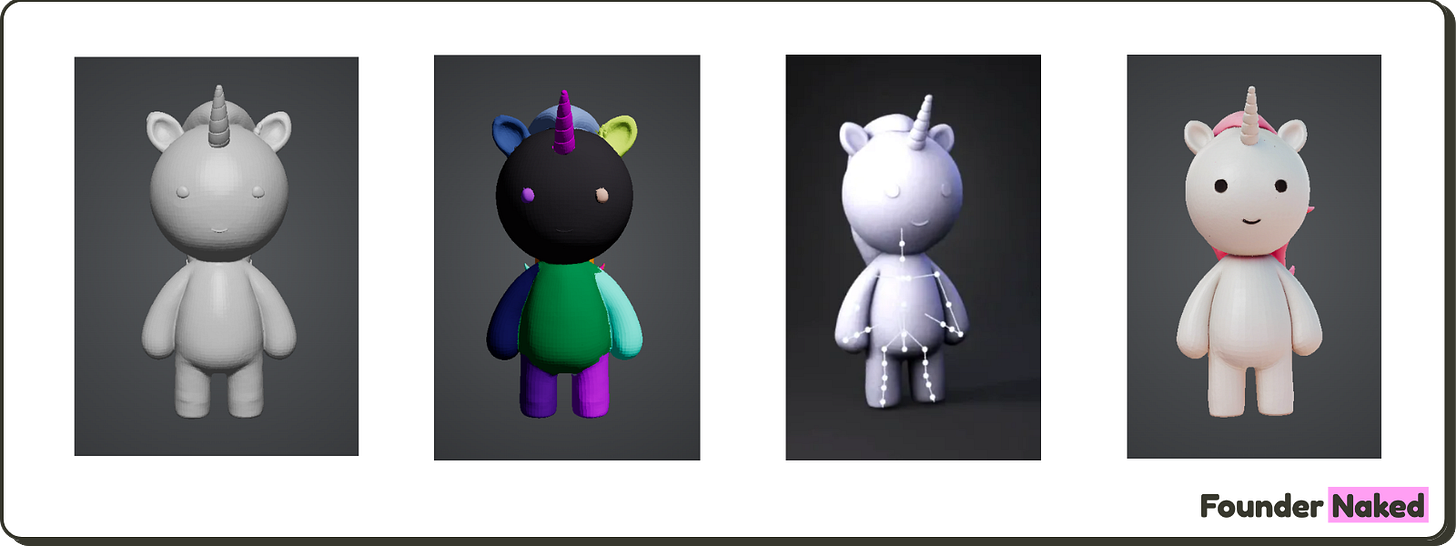

Ci-dessous je te mets un exemple du process Tripo pour passer d’une image à un personnage animé :

On transforme l’image en objet 3D, en ajustant le nombre de polygones (plus tu veux que ta forme 3D colle à ton dessin, plus il faut de polygones et plus l’image sera lourde à travailler) ;

En découpe ensuite l’image en parties du corps. L’IA fait un premier travail automatique, puis on affine manuellement ;

On ajuste ensuite le rig, c’est-à-dire les axes du corps, qui vont donner le mouvement du personnage (où places-tu le centre de gravité par exemple) ;

Et enfin on lui applique une texture, a priori la même que celle du personnage 2D qui a servi de matière à la création 3D.

Ensuite, une fois que l’on a fait toute ces étapes, on peut animer le personnage.

Pourquoi j’ai finalement opté pour la 2D

Et c’est là qu’on se rend compte que la “vraie” 3D n’est pas encore, même avec l’aide de l’IA, à la portée du commun des mortels. Et quand je dis 3D, je ne parle pas de vidéos — car demander à une IA de faire une vidéo à partir d’une image, ça se fait bien — mais obtenir un modèle 3D que l’on peut ensuite décliner, ça c’est dur.

C’est dur car l’IA fait encore des erreurs, et qu’il faut éditer le personnage.

En 2D aussi. Mais je maîtrise bien mieux l’édition photo ou vectorielle que l’édition 3D. Et je paries qu’il en est de même pour toi…

Et si on n’édite pas hyper proprement le personnage avant de l’animer, alors ça fait n’importe quoi. Les bouts de personnages, les textures, bougent dans tous les sens n’importe comment, et c’est inutilisable.

Ça, c’est la première raison.

La deuxième, c’est tout à fait propre à mon projet : comment animer le personnage de manière programmatique ? Comment faire coller le personnage à mon assistant IA, et que ce soit gérable, en termes de boulot pour moi, mais aussi en termes de taille de fichiers et de calculs ?

J’ai donc, au bout du compte, abandonné la 3D.

Le mot de la fin

J’espère que tu as trouvé cette édition intéressante, même si la conclusion c’est que je n’ai pas fait de 3D !

Tu l’auras compris, je partage mes réussites, mais aussi (et surtout) mon processus créatif, mes méthodes, tous les trucs que je teste et qui marchent ou ne marchent pas.

Ici, la création d’une mascotte m’a appris plein de trucs, et c’est assez représentatif de l’apprentissage de l’IA de manière générale : il faut que tu testes, testes, et testes. Il faut que tu apprennes an faisant, car il n’existe pas de recette magique.

Merci pour ta lecture. A lundi.

Yoann